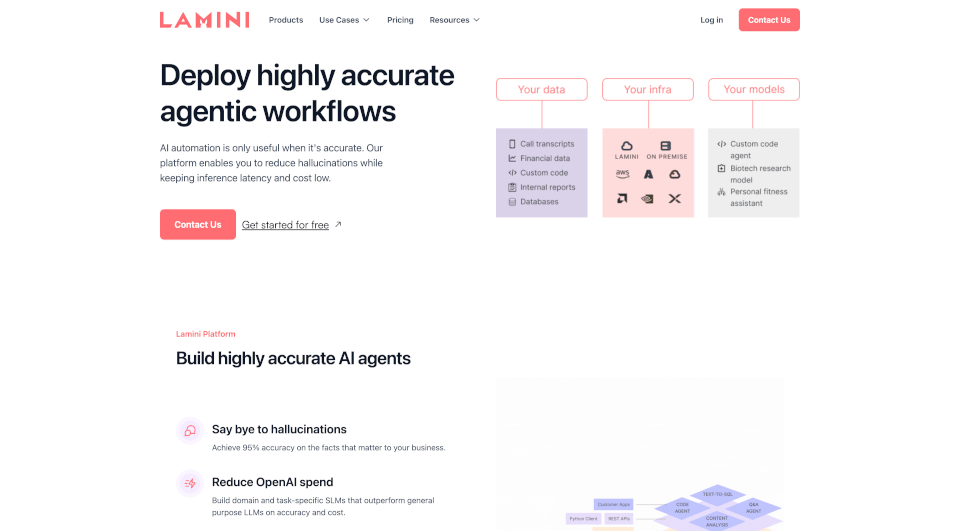

Laminiとは何ですか?

Laminiは、独自の大規模言語モデル(LLM)の開発と展開に取り組むソフトウェアチームのために特別に設計された革新的なエンタープライズLLMプラットフォームです。パフォーマンスの向上、幻覚の軽減、安全性の確保を重視し、Laminiは企業が数十億の社内文書を活用して高度に専門的なLLMを作成できるようにします。オンプレミスまたはクラウドにインストール可能なLaminiは、安全でスケーラブルな環境を提供し、企業が自信を持ってAIワークロードを管理できるようにします。AMDとの戦略的パートナーシップのおかげで、LaminiはAMD GPU上でLLMを効率的に実行できる唯一のプラットフォームであり、フォーチュン500企業や先端のAIスタートアップにとって欠かせない存在です。

Laminiの特徴は何ですか?

メモリチューニングによる比類なき精度の実現

Laminiはメモリチューニングを活用して、推論レイテンシーとコストを最小限に抑えながら、可能な限り最高の精度を提供します。この高度な機能により、ユーザーは驚異的なパフォーマンスレベルを達成でき、一般的なモデルを大幅に上回ります。

多様なユースケース

Laminiは、次のような多岐にわたるアプリケーションをサポートしています:

- テキストからSQLへ: 自然言語クエリをSQLコマンドに変換できる正確で効率的なエージェントの構築。

- 分類: 非構造化データを迅速にアクション化し、手動分類タスクを自動化。

- 関数呼び出し: 外部ツールやAPIをシームレスに統合し、生産性を向上させます。

拡張されたRAGメモリー

Laminiの特筆すべき機能の1つは、メモリーRAGです。このユニークなアプローチにより、情報検索を強化しながら生成品質を大幅に向上させ、幻覚を減少させることができるため、高精度が求められるアプリケーションに最適です。

自動分類

Laminiの分類器機能は、手動データラベリングをスケーラブルで正確な分類システムに置き換えます。この機能により、大規模な非構造化データセットを迅速かつ効果的に分類でき、管理の手間を削減します。

Laminiの特性は何ですか?

Laminiは次の特性を持っています:

- 高精度: 専門的なタスクで最大95%の精度を達成し、エラーを最小限に抑えAI出力への信頼性を最大化します。

- コスト効率: OpenAIの一般モデルへの依存を減少させることに焦点を当て、優れた結果を提供しながら、ドメイン特化型LLMを微調整できるようにします。

- セキュリティコンプライアンス: Laminiは、敏感なデータを保護するためにオンプレミスセットアップやエアギャップシステムといった安全な環境で展開可能です。

Laminiの使用例は何ですか?

Laminiの柔軟性により、さまざまなシナリオで利用可能です:

- カスタマーサポートの自動化: カスタマーサービス機能を拡張し、人間のエージェントが複雑なクエリに対応し、顧客関係を強化できるようにします。

- ビジネスインテリジェンス: チームが自己サービスによるビジネス分析を行えるようにし、クエリをアクショナルなSQLコマンドに変換することで意思決定プロセスを効率化します。

- コード支援: 専門的なプログラミング言語に特化したアシスタント機能を提供し、開発者が不明なコードベースをナビゲートし理解するのを助けます。

Laminiの使い方は?

Laminiを始めるための一般的な手順は次のとおりです:

- プラットフォームのセットアップ: 組織のニーズに基づいて、オンプレミスまたはクラウドインストールを選択します。

- LLMの微調整: Laminiの直感的なインターフェースを使って、専有データを用いてモデルを微調整し、精度とパフォーマンスを最適化します。

- ユースケースの実装: トレーニングを受けたモデルを、カスタマーサービス自動化、テキストからSQL、または業種別の分類タスクなどの特定のアプリケーションに展開します。

- 監視と保守: 定期的にモデルのパフォーマンスを評価し、高い精度と関連性を維持するために必要に応じて調整します。