什麼是Berri?

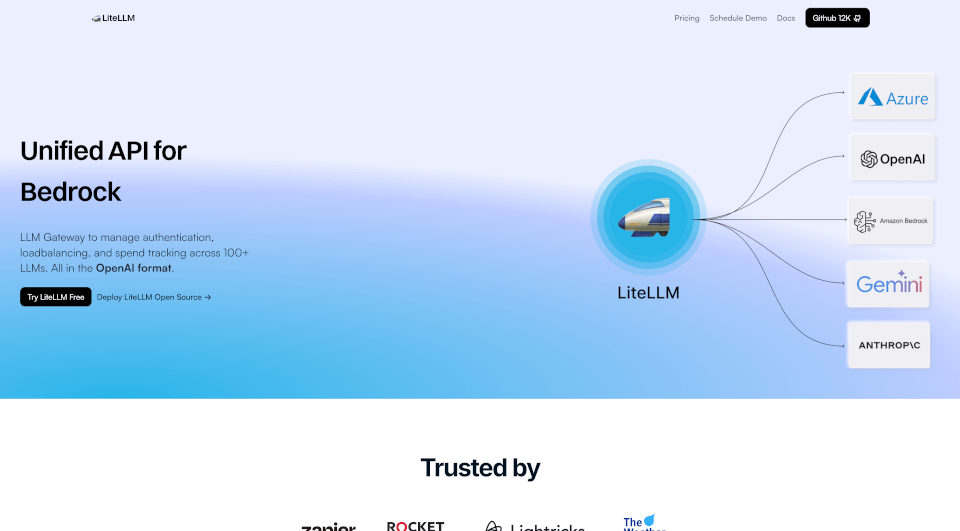

LiteLLM 是一個先進的解決方案,旨在透過統一的 API 簡化多個語言學習模型 (LLM) 的管理。具備 負載均衡、備援 和 開支追蹤 等功能,LiteLLM 提升效率,並提供順暢的整合能力,支持包括OpenAI、Azure OpenAI、Vertex AI 和 Bedrock 在內的 100 多個 LLM。無論您是開發者、數據科學家還是 AI 愛好者,LiteLLM 都能讓您輕鬆利用最前沿的 LLM 技術,而無需面對常見的複雜性。

Berri的特色是什麼?

- 多提供者的統一 API:LiteLLM 將各種模型聚合到單一 API 接口中,使開發者能以標準化的方式與多個 LLM 互動。

- 負載均衡:此功能優化請求的分配,確保性能均衡,避免特定模型過載。

- 備援機制:在 API 失敗的情況下,LiteLLM 自動將請求重新路由到替代模型,確保服務不間斷。

- 開支追蹤:精確管理和監控您在 LLM 上的耗費。LiteLLM 提供工具來設置預算並有效追蹤開支。

- 虛擬金鑰和預算:為不同的團隊或項目生成虛擬金鑰並分配特定預算,以有效管理成本。

- 監控和日誌記錄:持續監控請求和性能,與 Langfuse、Langsmith 和 OpenTelemetry 等整合,提供徹底的分析和日誌記錄。

- 指標和身份認證:支持 JWT 身份驗證、單點登錄 (SSO) 及審計日誌,以增強安全性和合規性。

- 社區和設置支持:擁有超過 200 名貢獻者及充滿活力的社區,LiteLLM 的支持隨時可用,使設置過程順利且資源豐富。

Berri的特性是什麼?

LiteLLM 在快速演變的 AI 環境中,由於其堅固的架構和以用戶為中心的設計而脫穎而出。其特點包括:

- 100% 正常運行保證:憑藉廣泛的基礎設施支持,用戶可以依賴不間斷訪問 LLM 服務。

- 開源靈活性:LiteLLM 作為開源解決方案,使用者可以根據需求修改和托管,促進適應性和創新。

- 高需求可靠性:超過 90,000 次 Docker 拉取和超過 2000 萬次請求處理突顯了 LiteLLM 的能力和社區中的信任。

- 無縫整合:提供簡單且強大的統一 API,LiteLLM 確保您的應用程序可以輕鬆連接到各種 LLM,而不會感到麻煩。

Berri的使用案例有哪些?

LiteLLM 是多功能的,可以在多個領域有效使用:

- 內容生成:企業可以使用 LiteLLM 自動生成書面內容、博客、營銷材料和產品描述,減少涉及的時間和精力。

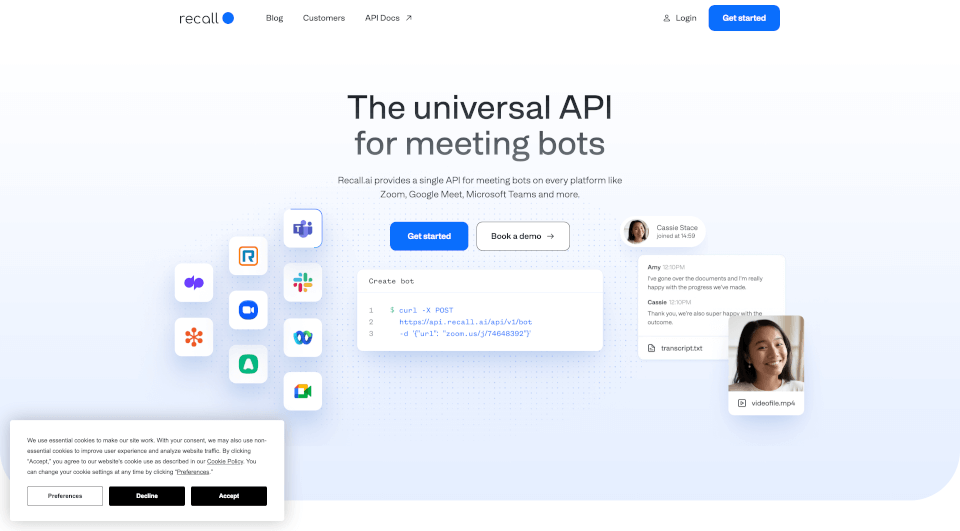

- 對話代理:在聊天機器人或虛擬助手中實施 LiteLLM,通過從不同的 LLM 提取見解,提升其反應能力和準確性。

- 數據分析:研究人員和分析師可以利用 LiteLLM 合成大量數據,通過進步的分析提升決策能力。

- 教育和學習工具:教育工作者可以通過整合 LLM 創建互動學習體驗,為學生提供即時反饋或個性化學習路徑。

- 創意應用:藝術家和創作者可以使用 LiteLLM 生成新想法、提升創造力,探索音樂、寫作和視覺藝術等創意途徑。

如何使用Berri?

要開始使用 LiteLLM,請遵循以下步驟:

- 安裝 LiteLLM:通過官方庫或 Docker 下載並安裝 LiteLLM。

- 創建帳戶:在 LiteLLM 平台上註冊以獲取訪問權限並獲取 API 金鑰。

- 配置提供者:選擇您偏好的 LLM 提供者並通過 LiteLLM 儀表板配置它們。

- 設置負載均衡:定義您的負載均衡偏好,以優化請求分配。

- 實施 API 調用:在您的應用程序代碼中使用 LiteLLM Python SDK 或直接 API 調用,開始利用 LLM 能力。

- 監控使用情況:通過提供的分析儀表板跟踪開支和使用情況,以確保最佳性能和成本效益。